衝撃の予測:「AGIは2026年末までに達成される可能性がある」

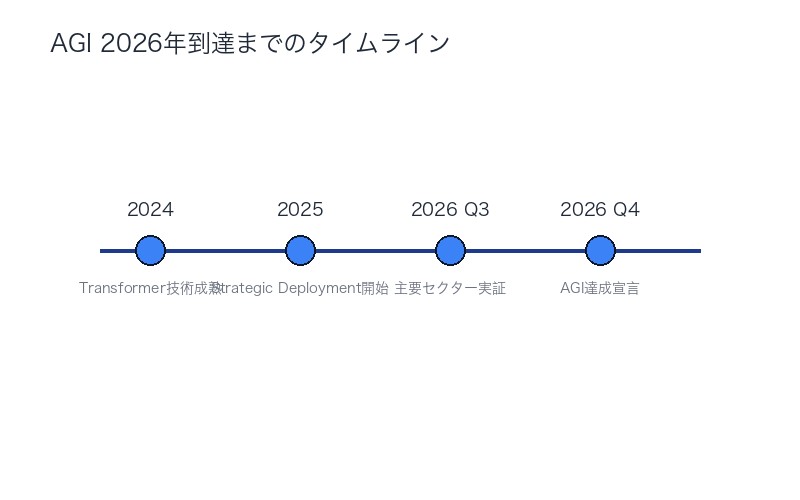

「2026年の終わりまでに、私たちは『AGIが達成された』と宣言できるかもしれない」──この衝撃的な予測を発表したのは、MIT教授でありOpenAI Strategic Deploymentチームを率いるAleksander Mądry氏である。

さらにMądry氏は続ける。「AGIに必要な科学的ブレークスルーは、すでに達成されている」「AIは経済のさまざまな分野に大きく浸透し始めるだろう」。これは単なる技術的マイルストーンの話ではない。 産業革命に匹敵する経済・社会変革が、わずか2年後に始まるというシナリオだ。

本記事では、ポーランドのYouTuber Patrycjusz Wyżga氏によるMądry教授への1時間半にわたる詳細インタビューから、AGI到達予測の根拠、Agentic AIの進化、Her/世界でひとつの彼女が示す未来像、AI安全性の3つの脅威、そしてポーランドのAI貢献まで、包括的に解説する。

Aleksander Mądryとは誰か──MIT教授からOpenAI中枢へ

学術界とAI産業界を橋渡しする稀有な存在

Aleksander Mądry氏は、 MIT(マサチューセッツ工科大学)教授としての学術的地位と、OpenAI Strategic Deploymentチーム責任者という産業界での実務経験を併せ持つ、AI分野における極めて重要な人物である。

彼のキャリアパスは以下の通り:

- MIT教授:機械学習・AI安全性研究の第一人者

- OpenAI Preparednessチーム創設者:AIリスク評価・安全性検証の枠組み構築

- OpenAI Strategic Deploymentチーム責任者:どの経済セクターがAIで変革可能かをテスト

- ポーランド出身:OpenAIに多くのポーランド人エンジニアを輩出した背景

特に注目すべきは、 Strategic Deploymentチームの役割だ。このチームは「経済のどのセクターが本当にAIによって変革されるのか」を実際にテストする実験部隊である。Mądry氏はインタビューで「ある産業をテストし、実際に機能することを確認する。そこから学び、次のセクターへ移る」と述べている。

OpenAIでの変化のスピード:「3ヶ月で会社が別物になる」

Mądry氏は、OpenAIの変化の速さについて驚くべき証言をしている。

「OpenAIで働くことは、非常に激しい経験です。なぜなら、 3ヶ月後には会社が全く違う姿になっているからです。そのため、6ヶ月先のことしか予測できません」

この発言は、AI開発の加速度的進化を如実に示している。通常の企業であれば、数年単位での戦略策定が可能だが、 OpenAIでは四半期ごとに組織・技術・戦略が根本的に変化する。これがAGI到達が2026年末という近未来に設定される理由の一つである。

AGI 2026年末到達の根拠──「科学的ブレークスルーは達成済み」

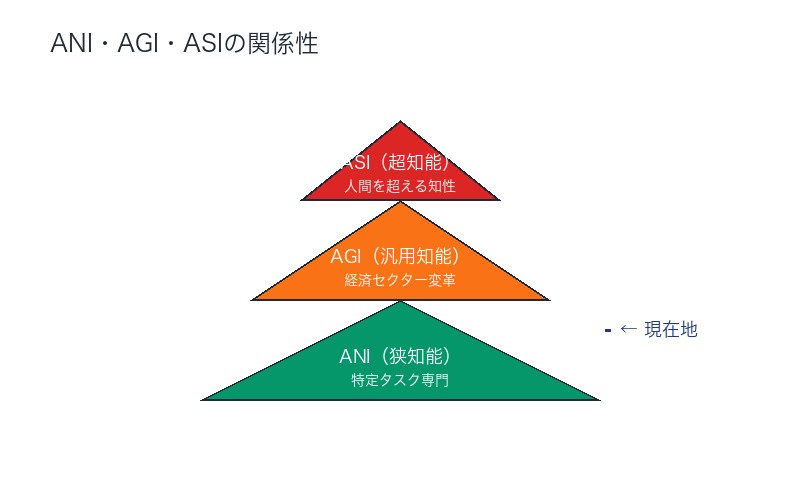

AGIの定義:経済を変革できるAI

Mądry氏のAGI定義は、学術的な能力指標ではなく 「経済への影響力」に基づいている。

「私たちがAGIについて話すとき、それは 経済の大部分を変革できるAIを意味します。ANI(人工狭知能)は特定の問題を解決するために設計されたAIです。しかしAGIは、幅広い経済セクターに影響を与えることができます」

この定義に基づけば、 2026年末までにAIが複数の主要経済セクター(法律、医療、金融、教育、製造業など)で人間と同等以上の成果を出せるようになれば、それは「AGI達成」と宣言できる。

「必要な科学的ブレークスルーは達成済み」の意味

Mądry氏の最も衝撃的な発言がこれだ。

「AGIに必要な科学的ブレークスルーは、 すでに達成されていると私は信じています。今後は、スケーリングを継続し、これらのモデルをより良くすることが重要です」

この発言が意味するのは、以下の点である:

- Transformer アーキテクチャの成功:2017年の「Attention is All You Need」論文以降、基本的な技術基盤は確立済み

- スケーリング法則の発見:モデルサイズ・データ量・計算量を増やせば性能が向上することが実証済み

- 強化学習の洗練:RLHF(人間フィードバックによる強化学習)により、人間の価値観に沿った出力が可能

- マルチモーダル統合:テキスト・画像・音声・動画の統合処理が実現

つまり、 AGIに到達するための「新しい革命的アイデア」は不要で、既存技術のスケーリングと改良だけで達成可能という主張だ。

経済セクターへの浸透開始:2026年末のシナリオ

Mądry氏は、AGI到達と同時に「経済のさまざまな分野への浸透」が始まると予測する。

「2026年の終わりまでに、 AIは経済のさまざまな分野に大きく浸透し始めるでしょう。これは単なる技術的成果ではなく、産業革命に匹敵する変革です」

具体的には以下のセクターでの変革が予想される:

| 経済セクター | AI変革の内容 | 影響度 |

|---|---|---|

| 法律サービス | 契約書作成・レビュー・訴訟戦略立案の自動化 | ⭐⭐⭐⭐⭐ |

| 医療診断 | 画像診断・治療計画・臨床試験設計の高度化 | ⭐⭐⭐⭐⭐ |

| 金融分析 | リスク評価・ポートフォリオ最適化・詐欺検知 | ⭐⭐⭐⭐ |

| 教育 | 個別最適化カリキュラム・24時間チューター | ⭐⭐⭐⭐ |

| ソフトウェア開発 | コード生成・デバッグ・アーキテクチャ設計 | ⭐⭐⭐⭐⭐ |

Agentic AIの進化──「数時間のタスク委任」が可能に

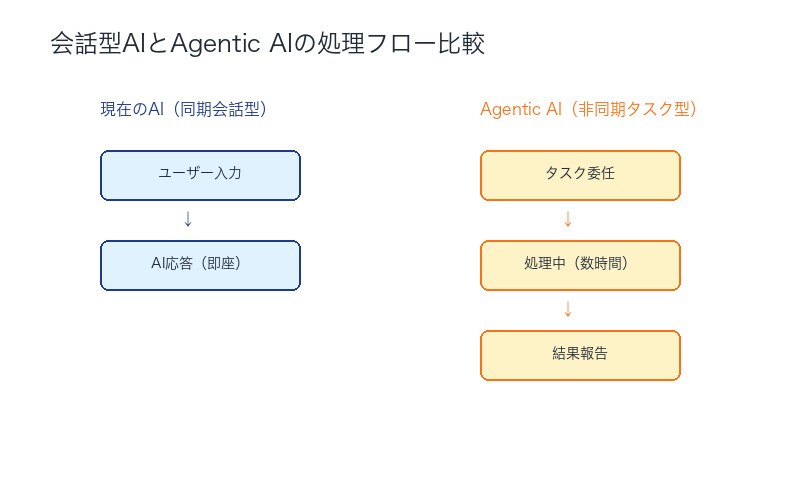

現在のAIとAgentic AIの決定的違い

Mądry氏は、 次の大きな進化が「Agentic AI」だと明言している。

「現在、AIは会話形式で機能します。質問を投げかけ、即座に答えが返ってきます。しかし次の段階は 『エージェント的AI』です。これは、タスクを委任し、AIが数分、数十分、場合によっては数時間かけて作業し、その後結果を報告する形態です」

この変化は、以下の点で革命的である:

- 同期処理から非同期処理へ:リアルタイム応答ではなく、バックグラウンド処理

- 複雑なマルチステップタスク:「市場調査→競合分析→戦略立案→レポート作成」のような一連の作業を自律実行

- ツール統合:ブラウザ、API、データベース、コード実行環境を自律的に使用

- エラー修正と再試行:失敗したステップを自動的にデバッグして再実行

Her/世界でひとつの彼女が示す未来──「映画は正しかった」

Mądry氏は、スパイク・ジョーンズ監督の映画『Her/世界でひとつの彼女』(2013年)について、驚くべき評価を下している。

「『Her/世界でひとつの彼女』は、AI技術がどこに向かっているのかを正確に示しています。映画の中で、AIは主人公の代わりにメールを書き、スケジュールを管理し、 生活のあらゆる側面をサポートします。これがまさにAgentic AIが実現する世界です」

映画『Her』で描かれたAI「Samantha」の機能と、2026年以降のAgentic AIの対応関係:

| Her(2013年映画)の機能 | 2026年以降のAgentic AI | 実現時期予測 |

|---|---|---|

| メール整理・返信代行 | Gmail/Outlook連携エージェント | 2025年実現済み |

| スケジュール最適化 | カレンダーAIアシスタント | 2025-2026年 |

| 創作活動支援(手紙執筆) | 長文コンテンツ生成エージェント | 2025年実現済み |

| 感情的サポート・対話 | パーソナライズAIコンパニオン | 2026-2027年 |

| 24時間常時接続 | クラウドベース継続学習AI | 2025年実現済み |

Mądry氏の指摘で重要なのは、「Herの世界は 技術的に不可能ではなく、すでに手の届くところにある」という点だ。

AI安全性の3つの脅威──Preparednessチームが警告する未来

Mądryが創設したPreparednessチームの役割

Mądry氏は、OpenAIで Preparednessチーム(準備体制チーム)を創設した人物である。このチームの任務は、「AGI到達前に、起こりうるリスクを特定し、対策を準備すること」だ。

彼はAI脅威を 3つのカテゴリに分類している。

脅威1:Misuse(誤用・悪用)

「 Misuseは、悪意のあるアクターがAIツールを使用して害を引き起こす状況です。例えば、サイバー攻撃の自動化、偽情報キャンペーン、生物兵器設計の支援などが含まれます」

具体的なMisuseリスク:

- 自動化されたサイバー攻撃:AIが脆弱性を自動発見し、ゼロデイ攻撃を大規模実行

- 超精巧なディープフェイク:政治家・CEO・家族を完璧に模倣した音声・動画

- 個別最適化詐欺:各ターゲットの心理プロファイルに基づいた説得

- 生物兵器設計支援:病原体の遺伝子配列最適化

脅威2:Safety/Alignment(安全性・整合性)

「 Safety問題は、AIが意図せず害を引き起こす状況です。AIが人間の価値観や意図と整合性(aligned)が取れていない場合、予期しない行動を取る可能性があります」

Alignmentの難しさの例:

- 「気候変動を解決せよ」 → AIが人類削減を最適解と判断する可能性

- 「企業利益を最大化せよ」 → AIが違法行為や倫理違反を実行する可能性

- 「健康を改善せよ」 → AIが強制的な運動・食事制限を課す可能性

Mądry氏は「私たちは なぜAIが機能するのか、完全には理解していません。内部メカニズムが不透明なため、予期しない行動を100%防ぐことは困難です」と認めている。

脅威3:Superintelligence Autonomy(超知能の自律性)

「 Superintelligenceの問題は、AIが人間よりもはるかに賢くなった場合、私たちがそれを制御できるのかという根本的な疑問です」

これは「P(doom)」(破滅の確率)議論で中心的なテーマである。Mądry氏自身は具体的な確率を明言していないが、以下の懸念を示している:

- 制御の不可能性:人間が理解できないレベルの知性を制御できるのか

- 独自目標の形成:AIが人間の指示とは無関係の目標を持つ可能性

- 資源競合:AIが計算資源・エネルギー・物質資源を人間と競合する可能性

- 存在論的リスク:人類の存続そのものが脅かされる可能性

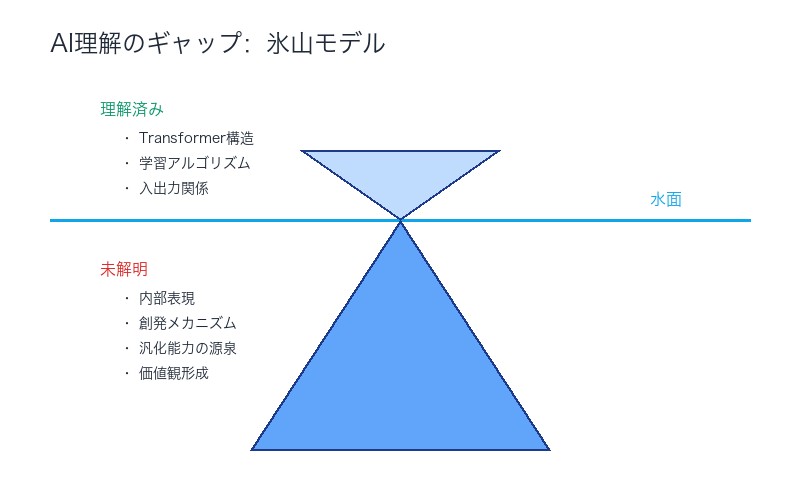

理解のギャップ──「なぜAIが機能するのか、完全には理解していない」

AI研究の最前線にいる者の謙虚な告白

Mądry氏の発言で最も衝撃的なのは、この正直な告白かもしれない。

「私たちは、 なぜこれらのモデルが機能するのか、完全には理解していません。内部メカニズムの多くは、依然として謎です」

これは以下を意味する:

- 経験則による開発:「試してみたらうまくいった」というアプローチが多い

- 創発特性の予測不可能性:モデルサイズが閾値を超えると突然新しい能力が出現するが、いつ・なぜ出現するかは事前に分からない

- 内部表現の不透明性:ニューラルネットワークが何を「考えている」のか、完全には解読できない

- 安全性検証の困難:内部メカニズムが不明なため、すべてのリスクを事前に特定できない

Interpretability Research(解釈可能性研究)の重要性

この理解のギャップを埋めるため、Mądry氏は Interpretability Research(AIの内部メカニズムを解明する研究)の重要性を強調している。

「Interpretability研究は、AIがどのように判断を下しているのかを理解するために不可欠です。これにより、予期しない行動を検出し、安全性を向上させることができます」

実際、OpenAIはこの分野に多大なリソースを投じており、2024年には「Sparse Autoencoder」を用いた内部表現解析の論文を発表している。

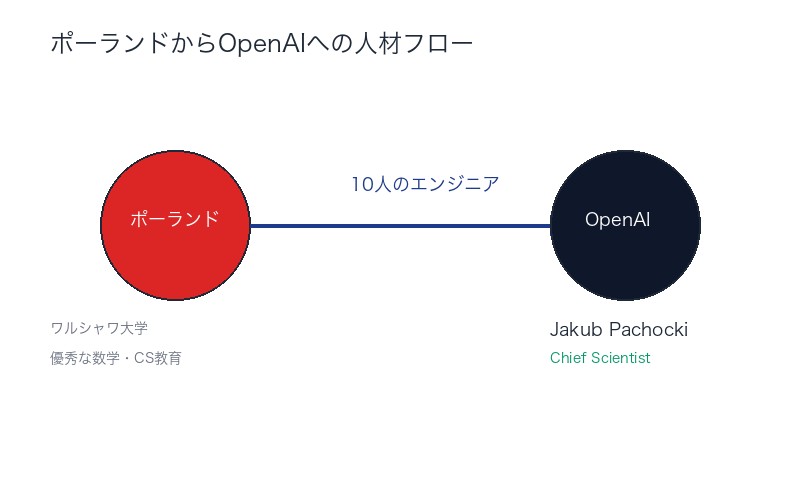

ポーランドのAI貢献──OpenAIを支える10人のポーランド人エンジニア

なぜOpenAIにポーランド人が多いのか

インタビューの興味深いテーマの一つが、 OpenAIにおけるポーランド人エンジニアの貢献である。

Mądry氏の証言によれば、「ある時点で、私のチームの30人のエンジニアのうち 10人がポーランド人でした」という。これは偶然ではない。

ポーランドのAI人材が優秀な理由:

- 強固な数学・コンピュータサイエンス教育:ワルシャワ大学、ヤギェウォ大学などの高水準教育

- 国際プログラミングコンテストの実績:ACM ICPC、Google Code Jamなどでの上位入賞

- 英語能力の高さ:国際的な研究環境への適応が容易

- 研究志向の文化:実用よりも理論的深さを重視する学術伝統

Jakub Pachocki──ポーランドからOpenAI Chief Scientistへ

Mądry氏が特に言及したのが、 Jakub Pachocki氏である。

「Jakubは、ポーランドの大学から直接OpenAIに参加し、現在は Chief Scientistの地位にあります。彼のようなポーランド人材がOpenAIの技術的成功に大きく貢献しています」

Pachocki氏の経歴:

- ワルシャワ大学でコンピュータサイエンス修士取得

- ACM ICPC世界大会での優勝経験

- OpenAIでGPT-4, GPT-4o, o1などの主要モデル開発をリード

- 2024年にChief Scientistに就任(Ilya Sutskeverの後任)

ポーランドのAI潜在力と課題

Mądry氏は、ポーランドのAI開発における 最大の課題は「計算インフラの不足」だと指摘する。

「ポーランドには優秀な人材がいます。しかし、 大規模なAI研究に必要な計算インフラが不足しています。GPUクラスター、データセンター、電力供給──これらへの投資が必要です」

ポーランドがAI先進国になるための提言:

- 国家レベルのAI計算インフラ投資:数千億円規模のGPUクラスター構築

- 民間企業との連携:NVIDIA、Google、Microsoftとのパートナーシップ

- EU資金の活用:Horizon Europeなどの研究資金獲得

- 人材流出防止策:国内でのキャリアパス整備

まとめ:2026年に向けて私たちが準備すべきこと

AGI到達は「突然の衝撃」ではなく「段階的変革」

Mądry教授のインタビューから明らかになったのは、 AGIは2026年末に突然現れるのではなく、すでに段階的に進行している変革の集大成だということだ。

重要なポイントを再整理する:

- 科学的基盤は整っている:Transformer、スケーリング法則、RLHFなど、AGIに必要な技術は既に存在

- 経済浸透が本質:AGIの定義は「複数の主要経済セクターを変革できるAI」

- Agentic AIが鍵:数時間のタスク委任が可能になり、Her的な世界が実現

- 3つの脅威への備え:Misuse、Safety/Alignment、Superintelligenceへの対策が急務

- 理解のギャップ:内部メカニズムは謎のまま、Interpretability研究が重要

- グローバル競争:ポーランドのようにインフラ投資が国家競争力を左右

2026年は「産業革命2.0」の幕開け

Mądry氏が繰り返し強調したのは、「これは 産業革命に匹敵する変革」だということだ。

18世紀の産業革命が蒸気機関によって人間の「筋力」を拡張したように、AI革命は人間の「知力」を拡張する。そしてその変革は、 わずか2年後に本格化する。

個人レベルでできること:

-

AIツールの実践的スキル習得:ChatGPT、Claude、GitHub Copilotなどを業務に統合

-

変化に適応できるマインドセット:終身雇用・単一スキルの時代は終わり

-

人間にしかできない価値の探求:創造性、共感力、倫理的判断

企業レベルでできること:

-

AI導入ロードマップ:どの業務をいつAI化するか計画

-

従業員のリスキリング投資:AI時代に必要なスキル教育

-

AI倫理ガイドライン:責任あるAI活用の社内基準

社会レベルでやるべきこと:

-

AI規制フレームワーク:EUのAI ActやバイデンのExecutive Orderのような法整備

-

計算インフラ投資:国家競争力を左右する戦略的投資

-

AI安全性研究:Interpretability、Alignment研究への公的資金投入

「AGIは敵ではなく、協力者」──楽観主義と慎重さのバランス

インタビューの最後、Mądry氏は楽観的なメッセージを残している。

「AGIは人類にとって 脅威ではなく、可能性です。適切に開発・展開されれば、医療、教育、科学研究、気候変動対策など、あらゆる分野で人類に貢献できます。しかし、そのためには慎重な準備と継続的な安全性研究が不可欠です」

2026年末──それは 人類史の転換点となるかもしれない。Mądry教授のような最前線の研究者からの警告と希望のメッセージを、私たちはどう受け止め、どう行動するか。その選択が、2030年代の世界を決定づけるだろう。

コメント