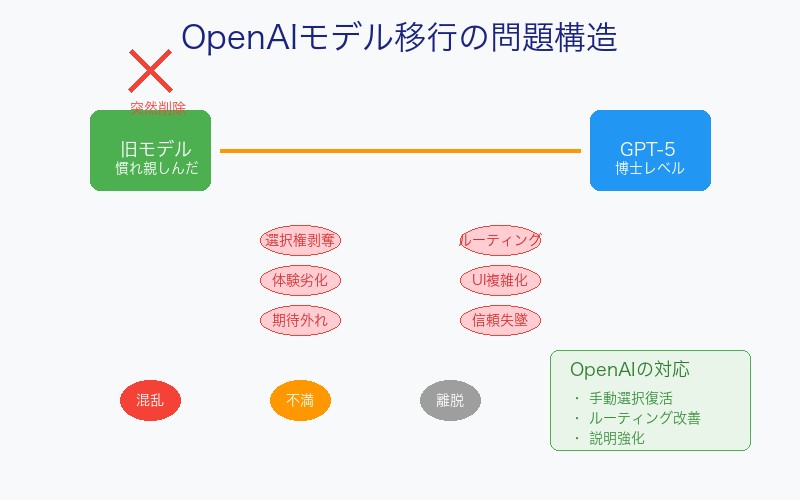

OpenAIのCEOサム・アルトマンが記者団との会話で、GPT-5のリリースに関する重要な発言を行いました。「博士レベル」の能力を謳うGPT-5に対するユーザーの期待外れの反応と、OpenAIが「完全にミスった」と認めた古いモデルの突然の削除問題について、業界に衝撃を与える内容となっています。

この発言は、AI業界のリーダー企業であるOpenAIが直面している技術的課題と運営上の問題を赤裸々に示すものとして、大きな注目を集めています。

サム・アルトマンの重大な認識:「完全にミスった」

今回のアルトマンCEOの発言で最も注目すべきは、OpenAIの運営方針に対する率直な反省です。

サム・アルトマンCEOの発言要旨:

「OpenAIが『完全にミスった』と認め、人々が慣れ親しんでいた古いモデルをオフにしたことを振り返りました」

この発言は、以下の重要な問題を浮き彫りにしています:

- ユーザー体験の軽視:既存ユーザーが慣れ親しんだ環境を突然変更した判断ミス

- 移行戦略の不備:新旧モデル間のスムーズな移行計画の欠如

- コミュニケーション不足:ユーザーへの事前説明と合意形成の不十分さ

- 技術優先主義の弊害:技術的進歩を優先し、ユーザビリティを軽視した結果

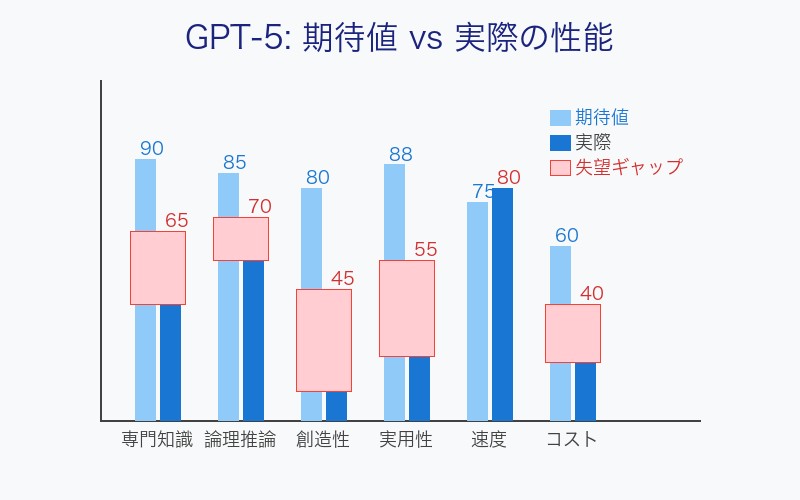

GPT-5の「博士レベル」能力への期待と現実

GPT-5は「博士レベル」の能力を持つとして大々的に発表されましたが、実際のユーザー体験は期待を大きく下回る結果となっています。

「博士レベル」能力の定義と現実のギャップ

OpenAIが謳う「博士レベル」の能力とは何を意味するのか、そして実際の性能との間にはどのような違いがあるのでしょうか:

| 能力領域 | 期待値(博士レベル) | 実際の性能 | ユーザー評価 |

|---|---|---|---|

| 専門知識の深度 | 高度な専門分野での詳細な洞察 | 表面的な知識の組み合わせ | 期待以下 |

| 論理的推論 | 複雑な問題の体系的解決 | 一定の改善は見られるが限界あり | 部分的満足 |

| 創造性 | 独創的なアイデアの創出 | 既存知識の再構成レベル | 期待以下 |

| 実用性 | 日常業務での高い有用性 | 前モデルとの明確な差別化困難 | 失望的 |

ユーザーからの具体的な不満

GPT-5に対するユーザーの反応は、OpenAIが想定していたものとは大きく異なっています:

主なユーザーの不満点:

- 体感できる性能向上の欠如:GPT-4との違いが実感できない

- 期待値の過剰な引き上げ:「博士レベル」という表現による期待の高まり

- 日常使用での実用性不足:理論的能力と実用性のギャップ

- コストパフォーマンスの問題:性能向上に見合わない利用コスト

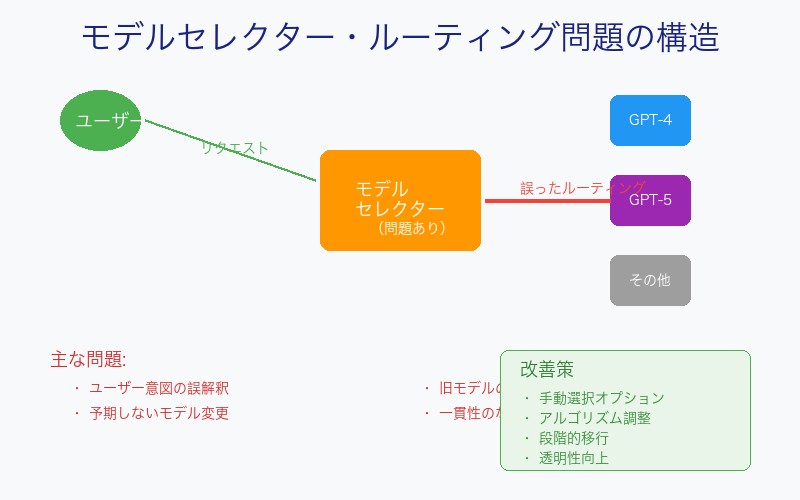

モデルセレクターとルーティング問題の深刻性

アルトマンCEOの発言で特に重要なのは、 モデルセレクターのルーティングと旧モデルの同時削除が誤りだったという認識です。

モデルセレクター問題の詳細分析

OpenAIのモデルセレクター機能は、ユーザーの要求に応じて最適なAIモデルを自動選択するシステムです。しかし、この機能の実装において重大な問題が発生しました:

- ルーティングアルゴリズムの不備

- ユーザーの意図と選択されるモデルの不一致

- タスクの複雑さに対する不適切な判断

- 過去の使用履歴の軽視

- 旧モデルの性急な削除

- ユーザーの選択権の剥奪

- 慣れ親しんだ環境の突然の変更

- 移行期間の設定不備

- ユーザー体験の劣化

- 予期しないモデル変更による作業効率の低下

- 出力品質の一貫性欠如

- 学習コストの増加

技術的課題と運営上の判断ミス

この問題は単純な技術的バグではなく、OpenAIの戦略的判断における根本的な誤りを示しています:

判断ミスの構造的要因:

- 内部視点の優先:エンジニアリング効率を重視し、ユーザー視点を軽視

- データ主導の落とし穴:定量的メトリクスに依存し、定性的体験を無視

- 競争圧力の影響:他社との競争を意識した性急なリリース判断

- コミュニケーション不足:開発チームとユーザー体験チーム間の連携不足

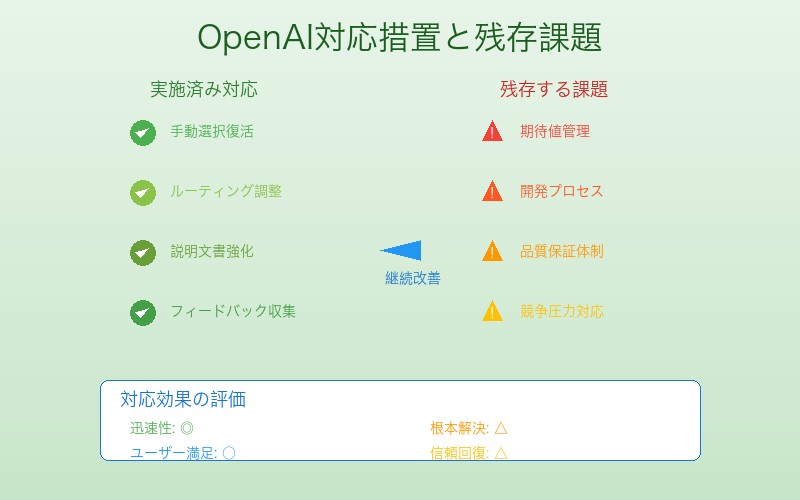

OpenAIの迅速な対応と残る課題

アルトマンCEOは、OpenAIが迅速に対応したことを評価する一方で、まだ多くの課題が残っていることも認めています。

実施済みの対応措置

OpenAIが問題発覚後に実施した対応措置は以下の通りです:

| 対応分野 | 具体的措置 | 効果 | 課題 |

|---|---|---|---|

| モデル選択権 | ユーザーによる手動選択機能の復活 | 選択の自由度回復 | UIの複雑化 |

| ルーティング改善 | アルゴリズムの調整と最適化 | 精度の部分的向上 | 根本的解決に至らず |

| コミュニケーション | 変更内容の詳細説明 | 透明性の向上 | 事後対応に留まる |

| フィードバック収集 | ユーザー調査の強化 | 問題把握の改善 | 対応速度の遅さ |

残存する根本的課題

迅速な対応にもかかわらず、OpenAIが直面している構造的問題は依然として解決されていません:

- 期待値管理の失敗:技術的能力の過大宣伝とマーケティング戦略の見直し必要性

- 開発プロセスの問題:ユーザー中心設計の欠如と内部効率優先の開発文化

- 品質保証体制の不備:リリース前のユーザビリティテスト不足

- 競争圧力への対応:市場競争と品質確保のバランス調整の困難

AI業界への波及効果と示唆

OpenAIのこの問題は、AI業界全体に重要な示唆を与えています。

業界リーダーの失敗が示す教訓

AI業界への重要な教訓:

- 技術的進歩 ≠ ユーザー価値:技術指標の向上が必ずしもユーザー体験の改善に直結しない

- 期待値管理の重要性:過度なマーケティングが長期的な信頼失墜を招く

- 移行戦略の必要性:新技術導入時の段階的移行とユーザー選択権の確保

- 透明性とコミュニケーション:変更内容の事前説明と合意形成の重要性

競合企業への影響

OpenAIの問題は、競合企業にとって重要な戦略的機会となっています:

- Anthropic(Claude):安定性と信頼性を強調した差別化戦略

- Google(Gemini):段階的改善と透明性の高いリリース戦略

- Microsoft(Copilot):企業向け安定性重視のポジショニング

- 新興企業:ユーザー中心設計を武器とした市場参入機会

ユーザー企業が取るべき対応策

OpenAIの問題を受けて、AI技術を活用する企業や個人ユーザーは以下の対応策を検討すべきです。

リスク分散戦略

1. マルチプロバイダー戦略

- 複数AI サービスの併用:OpenAI、Anthropic、Google等の組み合わせ使用

- 用途別の使い分け:タスクの特性に応じた最適なモデルの選択

- バックアップ体制の確立:主要プロバイダーに問題が発生した場合の代替手段

2. 社内AI戦略の見直し

- 過度な依存の回避:単一AI技術への依存リスクの分散

- 人材育成の継続:AI技術に完全に依存しない専門知識の維持

- 品質管理体制の強化:AI出力の検証と品質保証プロセスの確立

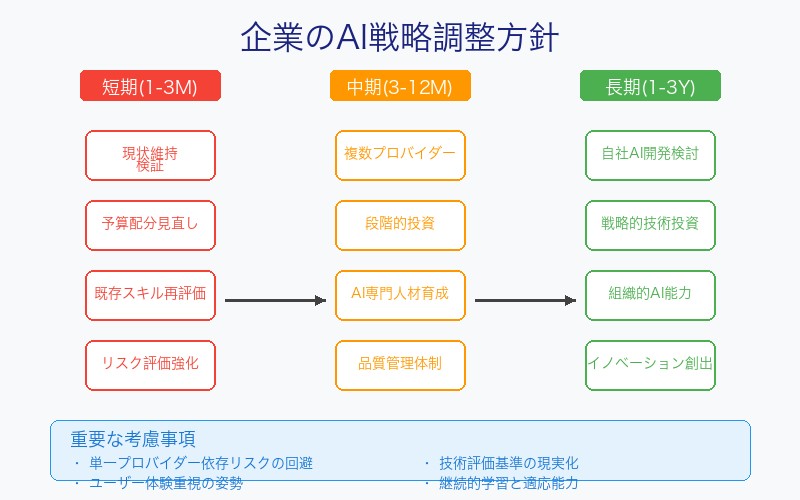

期待値管理とROI最適化

| 対応領域 | 短期対応(1-3ヶ月) | 中期対応(3-12ヶ月) | 長期対応(1-3年) |

|---|---|---|---|

| 技術選択 | 現状維持・検証強化 | 複数プロバイダー評価 | 自社AI開発検討 |

| 投資計画 | 予算配分の見直し | 段階的投資の実施 | 戦略的技術投資 |

| 人材戦略 | 既存スキルの再評価 | AI専門人材の育成 | 組織的AI能力の構築 |

AI技術の成熟度とハイプサイクル

今回のOpenAIの問題は、AI技術の成熟度とハイプサイクルにおける重要な転換点を示しています。

ガートナーのハイプサイクルにおける位置づけ

現在のAI技術、特に大規模言語モデルは以下の段階にあると考えられます:

- 「過度な期待」のピーク通過:GPT-4登場時の熱狂から現実的評価への移行

- 「幻滅の谷」への突入:実用性と期待値のギャップが明確化

- 「啓発の坂」への準備期間:現実的な活用方法の模索開始

技術成熟度の現実的評価

AI技術の現実的な成熟度評価:

- 強み:特定タスクでの高い性能、大量データ処理能力

- 限界:創造性・推論能力の制約、文脈理解の不完全さ

- 課題:コスト効率、信頼性、説明可能性の不足

- 機会:人間との協調による価値創出、特化型応用の拡大

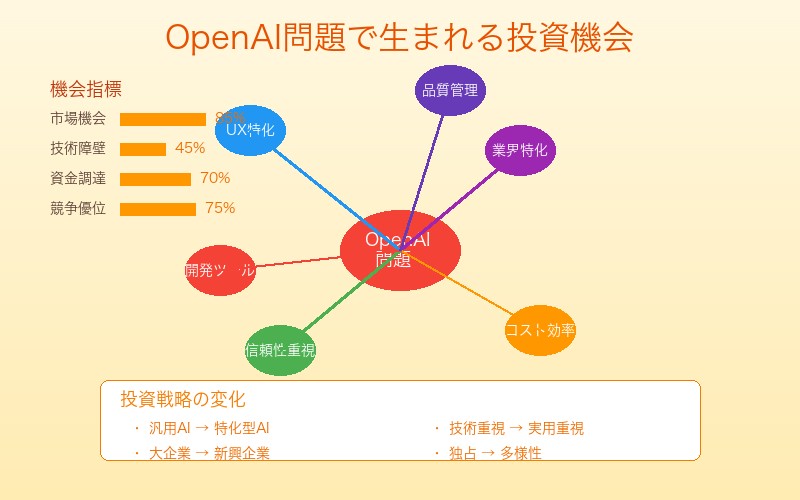

投資家とスタートアップへの影響

OpenAIの問題は、AI分野への投資戦略にも重要な影響を与えています。

投資トレンドの変化

1. 汎用AI から特化型AIへ

- 垂直統合型ソリューション:特定業界・用途に特化したAI開発

- ニッチ市場の開拓:大手が手薄な領域での差別化

- 実用性重視の評価基準:技術的新規性よりも実用価値を重視

2. AI インフラとツールチェーン

- 開発効率化ツール:AI開発・運用の効率化技術

- 品質管理・監視システム:AI出力の品質保証技術

- データプライバシー・セキュリティ:企業利用に必要な安全性確保

スタートアップの機会創出

OpenAIの問題は、新興企業にとって重要な参入機会を創出しています:

| 機会領域 | 参入戦略 | 差別化要因 |

|---|---|---|

| ユーザー体験特化 | UI/UX最適化 | 直感的操作性 |

| 業界特化型AI | 垂直統合ソリューション | 専門知識の深度 |

| コスト効率重視 | 軽量モデル開発 | 性能当たりコスト |

| 信頼性・安定性 | エンタープライズ向け | 運用保証・サポート |

今後の展望と予測

OpenAIの問題を踏まえた、AI業界の今後の展望を分析します。

短期的影響(6ヶ月-1年)

- 競合激化の加速

- Anthropic、Google等の市場シェア拡大

- OpenAI離れの企業ユーザー増加

- 価格競争の激化

- 業界標準の見直し

- ユーザビリティ重視の評価基準確立

- 透明性・説明責任の業界ルール策定

- 段階的移行のベストプラクティス共有

- 投資戦略の転換

- 実用性重視の投資判断

- リスク分散投資の増加

- 長期的視点での技術評価

中長期的変化(1-3年)

- AI技術の民主化:大手企業以外の技術アクセス向上

- 専門分野特化の進展:汎用AIから専門AIへのシフト

- 人間-AI協調の最適化:完全自動化から協調作業への転換

- 規制・ガバナンスの整備:業界自主規制と政府規制の確立

まとめ:AI時代の現実的な進歩へ

サム・アルトマンCEOの率直な認識と反省は、AI業界が重要な転換点を迎えていることを示しています。

重要な学習事項

- 技術進歩の限界認識:「博士レベル」のような大胆な表現と現実のギャップ

- ユーザー中心設計の重要性:技術優先から体験優先への転換必要性

- 透明性とコミュニケーション:変更内容の事前説明と合意形成の重要性

- 段階的改善の価値:革命的変化よりも着実な進歩の重要性

業界全体への示唆

- 持続可能な発展モデル:短期的競争より長期的信頼構築

- 現実的期待値の設定:マーケティングと技術現実のバランス

- エコシステムの健全性:一社独占でない多様性のある競争環境

- 社会的責任の自覚:技術が社会に与える影響への配慮

OpenAIの「完全にミスった」という率直な認識は、AI業界の成熟に向けた重要な一歩です。技術的な革新性だけでなく、ユーザー体験、透明性、信頼性を重視する方向への転換が、AI技術の真の社会実装につながるでしょう。

今回の問題は、AI業界全体にとって貴重な学習機会となります。OpenAIを含む全ての企業が、この教訓を活かしてより良い製品とサービスの提供を目指すことで、AI技術は真に人類に貢献する技術として発展していくことができるのです。

コメント