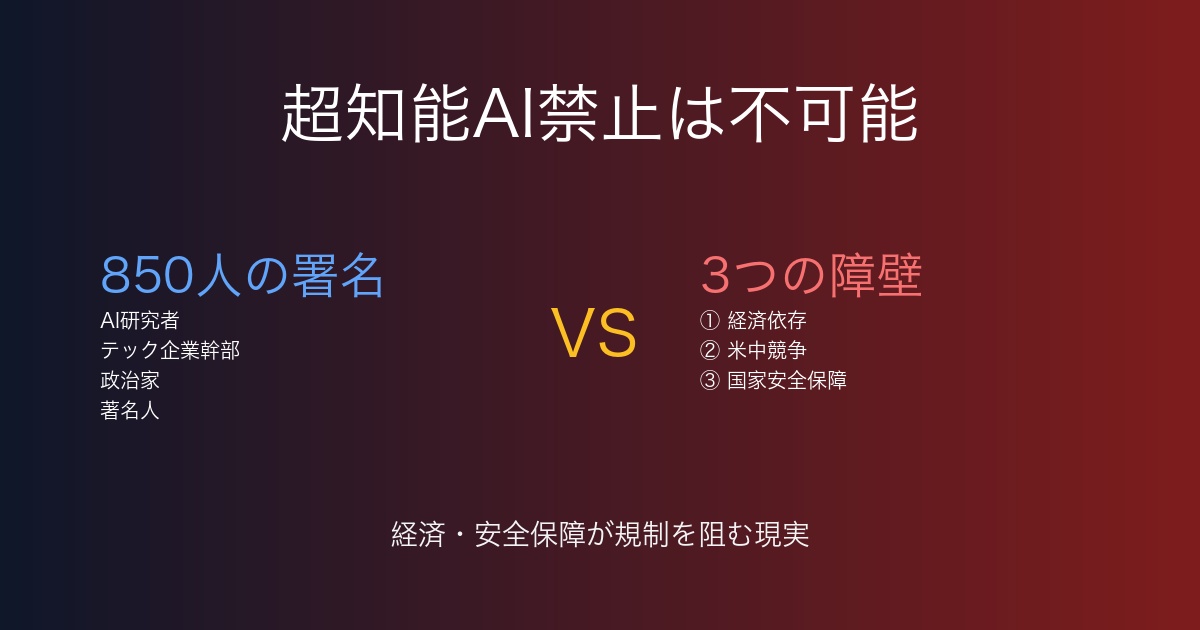

“Over 800 public figures, including “AI godfathers” and Steve Wozniak, sign open letter to ban superintelligent AI”?

— Chubby♨️ (@kimmonismus) October 23, 2025

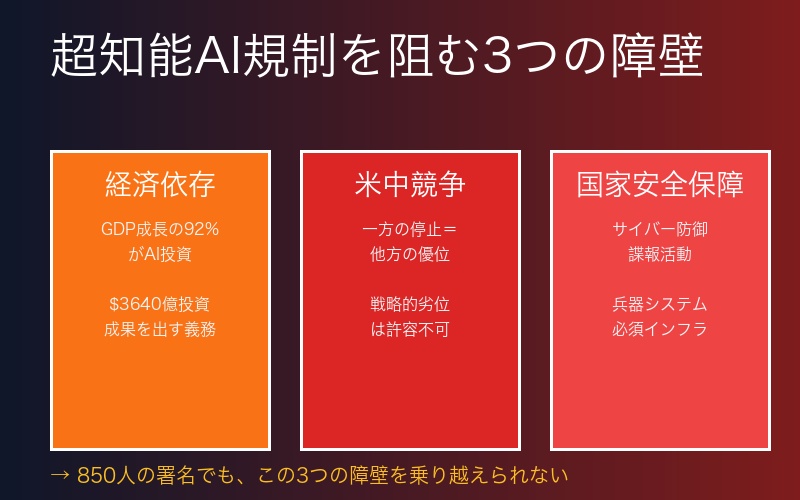

It’s too late, that won’t happen. Here are a few reasons why:

– Currently, all economic growth in the US is based on data center CapEx. Without these investments, the country would be in recession. What’s more, these investments will also have to pay off in the future. A pause? Impossible.

– Even if the US said it was taking a break, that would be a strategic advantage for China—to catch up with and overtake the US as quickly as possible. In short: a break for one party would be an advantage for the other.

– Furthermore, AI has long been declared strategic for national security; global competition will use AI to gain political advantages.

In summary: no one will stop striving for superintelligence. There is no doubt about that.

「AIの進化を止めるべきなのか?」 「850人以上の著名人が署名した嘆願書は実現するのか?」 「超知能AI開発は本当に禁止できるのか?」

2025年10月22日、 歴史的な公開書簡が発表された。

Geoffrey HintonとYoshua Bengio(AIのゴッドファーザー)、Steve Wozniak(Apple共同創業者)、Prince Harry、Richard Bransonを含む850人以上の著名人が、超知能AI開発の禁止を求める声明に署名したのだ。

しかし、結論は明確だ── 「もう遅すぎる、禁止は起こらない」。

この記事では、なぜ850人もの署名があっても超知能AI開発が止まらないのか、その3つの決定的理由を徹底解説する。

850人署名の衝撃──AIのゴッドファーザーからロイヤルファミリーまで

Future of Life Instituteが組織した史上最大規模の嘆願

公開書簡の内容:

「超知能の開発を禁止し、それが安全かつ制御可能に行われるという広範な科学的コンセンサスと強力な国民の支持が得られるまで、この禁止を解除しない」

– Future of Life Institute、2025年10月22日

Future of Life Institute(FLI)とは:

- AI安全性に焦点を当てた非営利組織

- 2015年設立、Elon Muskも支援

- 過去にもAI開発の一時停止を求める書簡を発表(2023年)

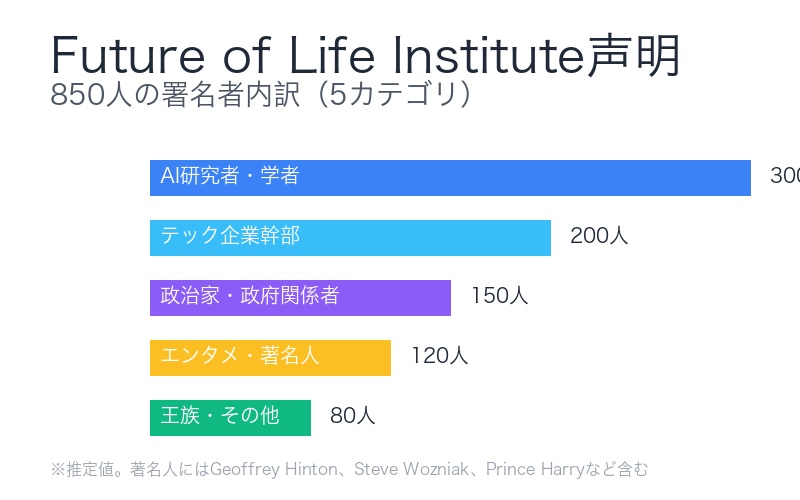

850人の署名者:5つのカテゴリ

①AI研究者・ノーベル賞受賞者

| 氏名 | 肩書 | 主な業績 |

|---|---|---|

| Geoffrey Hinton | AI研究者、ノーベル物理学賞(2024) | 深層学習の父、元Google |

| Yoshua Bengio | AI研究者、チューリング賞(2018) | 深層学習のパイオニア |

| 他4名のノーベル賞受賞者 | 各分野の権威 | – |

| 数十名の教授 | 大学研究者 | AI・倫理・政策 |

②テクノロジー業界

| 氏名 | 肩書 |

|---|---|

| Steve Wozniak | Apple共同創業者 |

| Richard Branson | Virgin Group創業者 |

③政治家・元政府高官

- 6名の元国会議員(米国)

- 3名の欧州議会議員

- Mike Mullen(元統合参謀本部議長)

- Susan Rice(元国家安全保障担当大統領補佐官)

- Steve Bannon(元トランプ政権首席戦略官)

④エンターテインメント・文化人

- Joseph Gordon-Levitt(俳優)

- will.i.am(ミュージシャン)

- Grimes(ミュージシャン)

- Glenn Beck(保守系コメンテーター)

⑤ロイヤルファミリー

- Prince Harry

- Meghan Markle(サセックス公爵夫妻)

書簡が警告するリスク

超知能AIの追求は以下の深刻なリスクをもたらす:

- 人間の経済的陳腐化と無力化

- 自由、市民的自由、尊厳、制御の喪失

- 国家安全保障へのリスク

- 人類絶滅の可能性

Yoshua Bengioの声明

「AIシステムは数年以内にほとんどの認知タスクでほとんどの個人を超える可能性がある」

「そのような進歩は世界的課題の解決に役立つ可能性があるが、重大なリスクも伴う」

– Yoshua Bengio、コンピュータ科学者

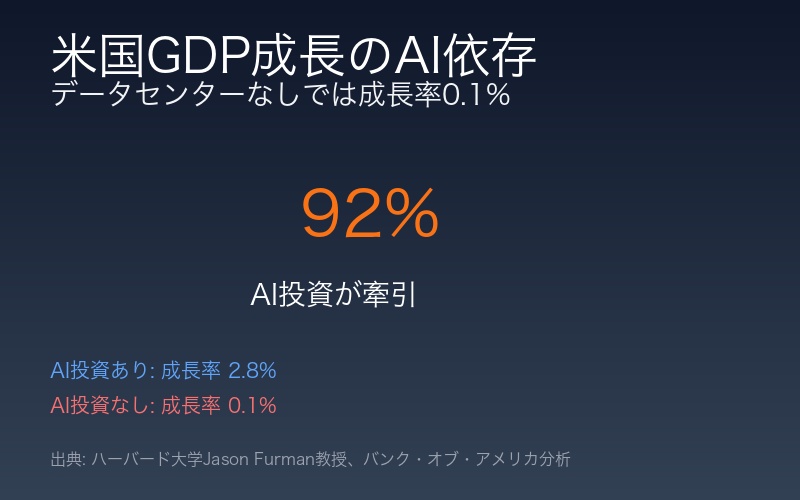

理由①:経済的依存──GDP成長の92%がAI投資

データセンター投資なしでは不況

「現在、米国のすべての経済成長はデータセンターの設備投資に基づいている。これらの投資がなければ、この国は不況に陥る」

– Chubby氏、X投稿より

前回記事で解説した経済データの再掲:

| 指標 | 数値 | 出典 |

|---|---|---|

| AI投資のGDP貢献(Q2 2025) | 1.3% | Bank of America |

| AI除外時のGDP成長率(上半期) | 0.1% | Jason Furman(ハーバード大) |

| GDP成長の構成比(AI投資) | 92% | 情報処理機器・ソフトウェア投資 |

「一時停止」は経済崩壊を意味する

AI開発を一時停止した場合のシナリオ:

- データセンター投資の停止 → 年間4,000億ドルの投資消失

- GDP成長の92%が消失 → 実質的に成長率マイナス転落

- 4大テック(Microsoft、Meta、Alphabet、Amazon)の投資削減 → S&P500の資本支出25%が蒸発

- 深刻な不況 → 失業率急上昇、株式市場暴落

「これらの投資は将来、成果を上げなければならない。停止? 不可能だ」

理由②:米中戦略的競争──一方の停止は他方の優位

「中国脅威」論がAI規制の最大の障壁

「たとえ米国が一時停止すると言ったとしても、それは中国にとって戦略的な優位性となる──できるだけ早く米国に追いつき、追い越すためだ」

「要するに、一方の停止は他方の優位性となる」

米中AI競争の現状

| 項目 | 米国 | 中国 |

|---|---|---|

| AI投資額(2025年) | ~2,000億ドル | ~1,500億ドル |

| 先端AIモデル開発 | リード | 急速に追随 |

| 半導体製造 | 輸出規制で優位 | 国内生産体制構築中 |

| データ量 | 優位 | 14億人のデータ |

| 規制環境 | ほぼ無規制 | 国家主導 |

「AI軍拡競争」論の威力

テック業界と政府の共通認識:

「『中国脅威』は、AI規制に反対する論拠としてテック業界が使用してきた」

「米国政府とテック業界の一部は、AI軍拡競争のレトリックを受け入れ、中国を減速させる論拠を支持している」

– AI Now Institute

この論理の帰結:

- 米国が一時停止 → 中国が加速 → 米国の戦略的劣位

- 中国が一時停止 → あり得ない(国家主導のAI開発)

- 両国が同時に停止 → 実現不可能(相互不信)

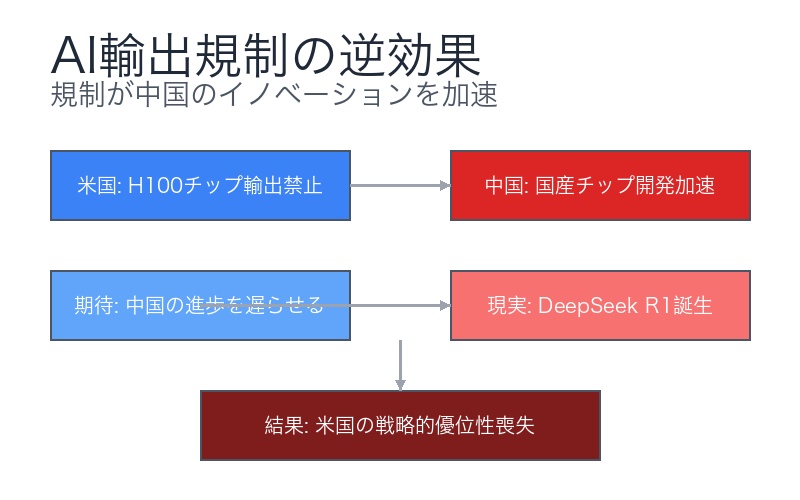

輸出規制の逆効果

皮肉な結果:

「米国が規制の壁を構築している間、中国は競合他社を包囲している──世界中のチョークポイントを支配する未来の基盤を築いている」

「輸出規制は意図せず中国のチップメーカーへの需要を促進しており、AI企業が米国サプライヤーではなく中国サプライヤーを選択するたびに、米国半導体業界は地歩を失っている」

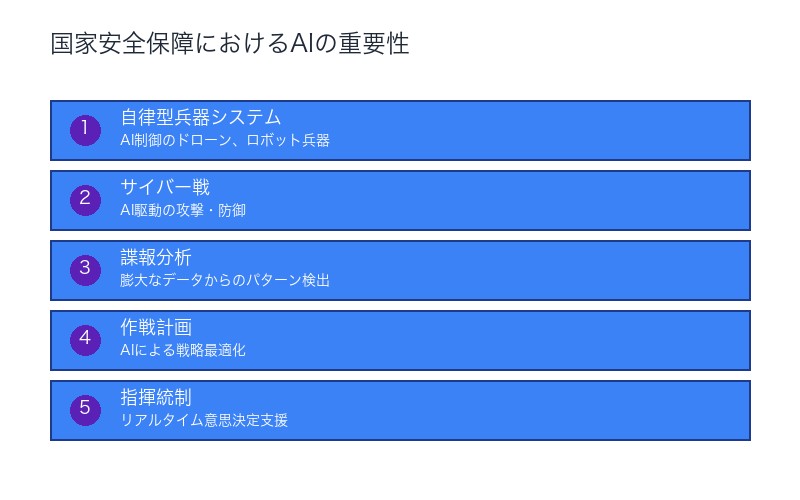

理由③:国家安全保障──AIは戦略的要素

AIは「例外的セクター」として位置づけ

「AIは長らく国家安全保障の戦略的要素と見なされており、グローバルな競争ではAIが政治的優位性を獲得するために利用される」

米国のAI戦略における位置づけ:

「米国は過去2年間で、AIを国家の経済的・国家安全保障上の利益の中核となる例外的セクターとして扱う立場を採用した」

– AI Now Institute

AIの軍事的・安全保障的応用

| 分野 | AI応用例 | 戦略的重要性 |

|---|---|---|

| サイバー防衛 | 脅威検知、侵入防御 | 極めて高い |

| 諜報活動 | 情報収集・分析、パターン認識 | 極めて高い |

| 軍事作戦 | 自律兵器、戦術分析 | 高い |

| 情報戦 | 偽情報検知・拡散 | 高い |

| 経済安全保障 | 技術覇権、産業競争力 | 極めて高い |

「停止」は安全保障の放棄を意味する

国防総省の視点:

- AI開発の停止 = 中国への軍事的優位の譲渡

- サイバー防衛能力の低下

- 諜報能力の劣化

- 同盟国への信頼性低下

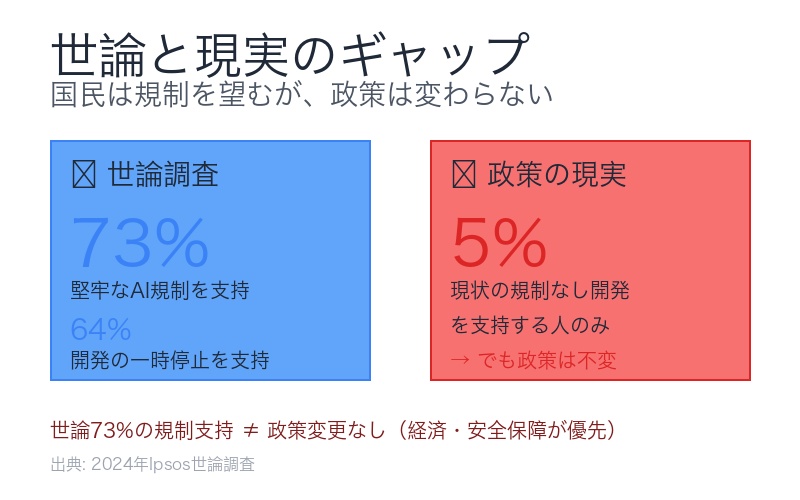

世論 vs 現実──73%が規制支持も実現せず

Future of Life Instituteの世論調査結果

「米国成人のわずか5%が現在の無規制なAI開発の現状を支持している」

「一方で、73%は先進的AIに対する強固な規制を望んでいる」

「64%は超知能が証明可能に安全かつ制御可能になるまで開発すべきでないと同意している」

| 世論調査項目 | 支持率 |

|---|---|

| 現状維持(無規制開発)を支持 | 5% |

| 安全が証明されるまで開発停止を支持 | 64% |

| 強固なAI規制を支持 | 73% |

なぜ世論が反映されないのか

民主主義の失敗?いいえ、経済と地政学の優先

- 経済的利益集団の影響力

- 4大テック(Microsoft、Meta、Alphabet、Amazon)の政治的影響力

- AI産業全体のロビー活動

- 雇用維持への圧力

- 国家安全保障の優先

- 国防総省の反対

- 諜報機関の懸念

- 「中国に負けられない」という強迫観念

- 経済崩壊への恐怖

- AI投資停止 = 不況

- 株式市場の暴落リスク

- 雇用喪失の恐れ

トランプ政権の全面支持

「AI開発は最小限の監視で猛スピードで進んでおり、トランプ政権の全面的な支持を受けている」

政権の方針:

- 「非規制的アプローチ」を推奨(具体的手法は不明確)

- AI企業への規制緩和

- 中国との競争を最優先

850人署名の限界──専門家の警告は経済に勝てない

ノーベル賞受賞者とゴッドファーザーの声も届かず

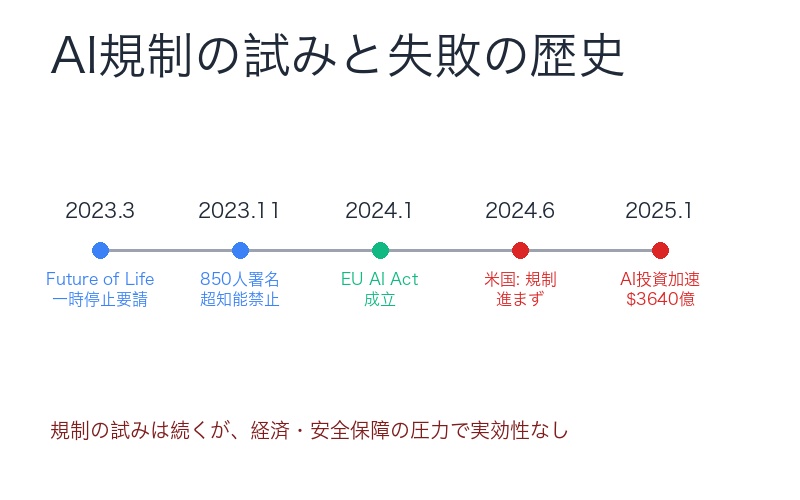

過去の類似事例:

| 年 | 署名運動 | 結果 |

|---|---|---|

| 2023年3月 | FLI「6ヶ月間のAI開発停止」署名(Elon Musk等) | 実現せず |

| 2025年10月 | FLI「超知能AI禁止」署名(850人) | 実現の見込みなし |

なぜ専門家の警告は無視されるのか

「圧倒的多数が規制を望んでいるが、経済と地政学が優先される」

3つの構造的理由:

| 理由 | 説明 | 優先順位 |

|---|---|---|

| 経済依存 | GDP成長の92%がAI投資 | 最優先 |

| 地政学的競争 | 米中AI覇権争い | 最優先 |

| 国家安全保障 | 軍事・諜報での優位 | 最優先 |

| 世論・専門家の警告 | 73%が規制支持 | 低い |

まとめ:「もう遅すぎる」──誰も超知能への努力を止めない

| 事実 | 詳細 |

|---|---|

| 850人署名 | Geoffrey Hinton、Yoshua Bengio、Steve Wozniak、Prince Harry含む |

| 世論調査 | 73%が強固な規制を支持、64%が開発停止支持 |

| 経済依存 | GDP成長の92%がAI投資、停止=不況 |

| 米中競争 | 一方の停止=他方の優位 |

| 国家安全保障 | AIは戦略的要素、停止=安全保障の放棄 |

| 結論 | 「もう遅すぎる、禁止は起こらない」 |

3つの決定的理由

①経済的不可能性

- 米国経済はAI投資に完全依存

- 停止=GDP成長の92%消失=深刻な不況

- 4,000億ドル/年の投資が蒸発

②戦略的不可能性

- 米国が停止→中国が加速→戦略的劣位

- 「AI軍拡競争」論が規制を阻む

- 両国の同時停止は相互不信で実現不可能

③安全保障上の不可能性

- AIは国家安全保障の中核的要素

- 軍事・諜報・サイバー防衛で不可欠

- 停止=安全保障の放棄

世論と現実のギャップ

| 世論 | vs | 現実 |

|---|---|---|

| 73%が規制支持 | ≠ | ほぼ無規制で開発継続 |

| 64%が開発停止支持 | ≠ | 開発は加速中 |

| 850人の著名人が署名 | ≠ | 政策変更なし |

最後に:止められない理由、止まらない現実

「要約すると:誰も超知能への努力を止めることはない。それは疑いようがない」

– Chubby氏、X投稿より

2025年10月、850人の著名人が 超知能AI禁止を嘆願した。

AIのゴッドファーザー(Geoffrey Hinton、Yoshua Bengio)、Apple共同創業者(Steve Wozniak)、ロイヤルファミリー(Prince Harry)──これ以上の権威はない。

世論調査でも 73%が規制を支持している。

しかし、 現実は変わらない。

なぜなら、米国経済は GDP成長の92%をAI投資に依存しており、停止すれば不況に陥るからだ。中国との戦略的競争があり、一方が停止すれば他方が優位に立つ。そして、AIは国家安全保障の中核であり、放棄は選択肢にない。

経済、地政学、安全保障──これら3つの理由が、世論と専門家の警告を圧倒する。

「もう遅すぎる」。

超知能AIへの競争は止まらない。それが、2025年の冷徹な現実である。

コメント