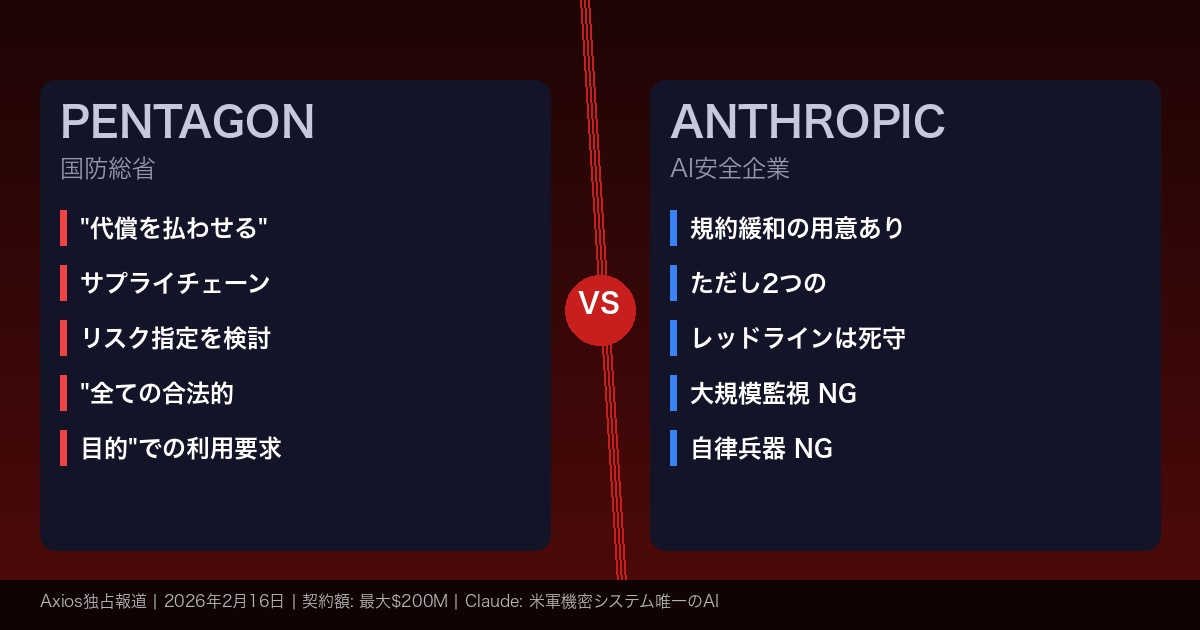

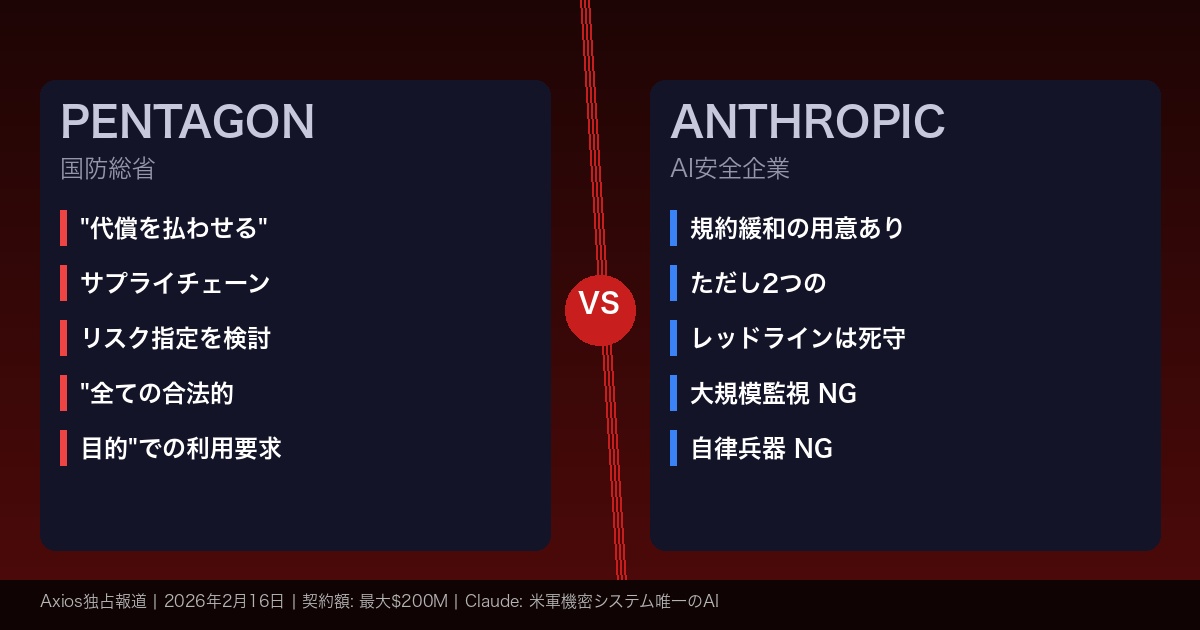

米国防総省とAI企業Anthropicの対立が、前例のない水準にまでエスカレートしている。Axiosの独占報道によると、ピート・ヘグセス国防長官はAnthropicとの取引関係を断絶し、同社を「サプライチェーンリスク」に指定する寸前にまで追い込んでいるという。

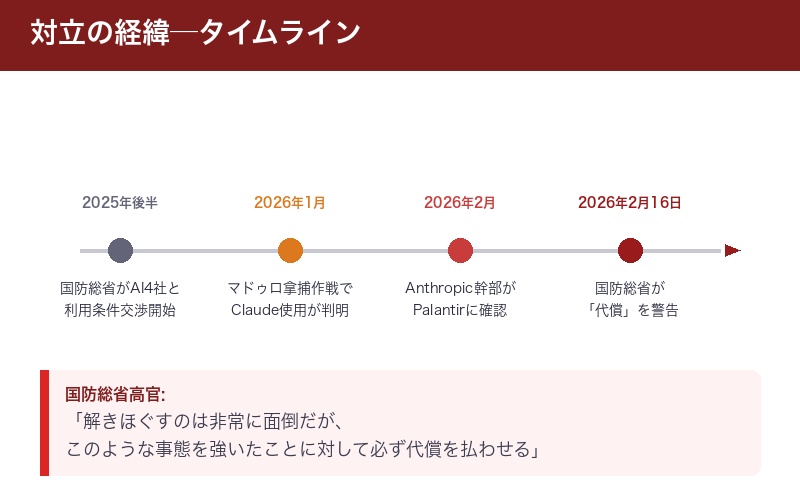

国防総省高官はAxiosに対し、「解きほぐすのは非常に面倒だが、このような事態を強いたことに対して必ず代償を払わせる」と発言。この種の制裁措置は通常、外国の敵対国に対してのみ適用される異例の対応だ。

Anthropicは利用規約の緩和に応じる姿勢を見せているが、アメリカ人の大規模監視と人間の関与なしに発射する自律兵器の2点だけは譲れない「レッドライン」として堅持している。この対立は、AI時代における国家安全保障と倫理の根本的な衝突を象徴するものだ。

何が起きているのか─対立の経緯

国防総省とAnthropicの間では、数ヶ月にわたる激しい交渉が続いてきた。対立の発端は、米軍がAnthropicのClaudeをどのような条件で使用できるかという根本的な問題だ。

国防総省はAnthropicを含む4つの主要AIラボ(OpenAI、Google、xAI)に対し、軍が自社ツールを「全ての合法的目的」に使用できるよう求めている。一方Anthropicは、特定の用途に制限を設けることを主張し続けてきた。

決定的な転機となったのは、マドゥロ大統領拿捕作戦での出来事だ。2026年1月、米軍がベネズエラのマドゥロ大統領を拿捕する作戦で、PalantirがClaudeを使用していたことが判明。Anthropicの幹部がPalantirに連絡を取り、Claudeが使われたかどうかを確認したが、トランプ政権高官によると「作戦中に銃撃があったため、ソフトウェアの使用を不承認とする意味合いで提起された」という。

Anthropic側は特定の作戦について議論したことを否定し、会話の焦点は「完全自律兵器と国内大規模監視に関するハードリミット」だったと説明している。

「サプライチェーンリスク」指定の衝撃

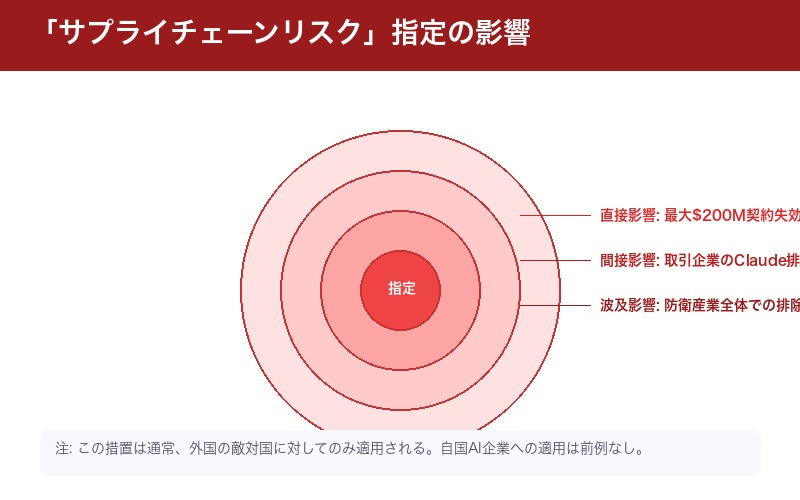

国防総省が検討している最も強力な制裁措置が、Anthropicの「サプライチェーンリスク」指定だ。これは通常、外国の敵対国(中国企業やロシア関連企業など)に対してのみ適用される極めて厳しい措置である。

この指定が実行された場合の影響は甚大だ:

| 影響範囲 | 内容 |

|---|---|

| 直接契約 | 最大2億ドル(約300億円)の国防総省契約が失効 |

| 間接影響 | 国防総省と取引する全企業がClaudeを使用していないことを証明する必要 |

| 市場への波及 | 防衛産業全体でのClaude排除が連鎖する可能性 |

| 信頼性への影響 | 「敵対国扱い」のレッテルが企業イメージに深刻な打撃 |

ただし、この契約は最大2億ドルであり、Anthropicの年間売上高140億ドルのわずか1.4%に過ぎない。金額面では限定的だが、Claudeが米軍の機密システムで利用可能な唯一のAIモデルであるという現実が、この問題の複雑さを際立たせている。

Anthropicの「レッドライン」─2つの譲れない条件

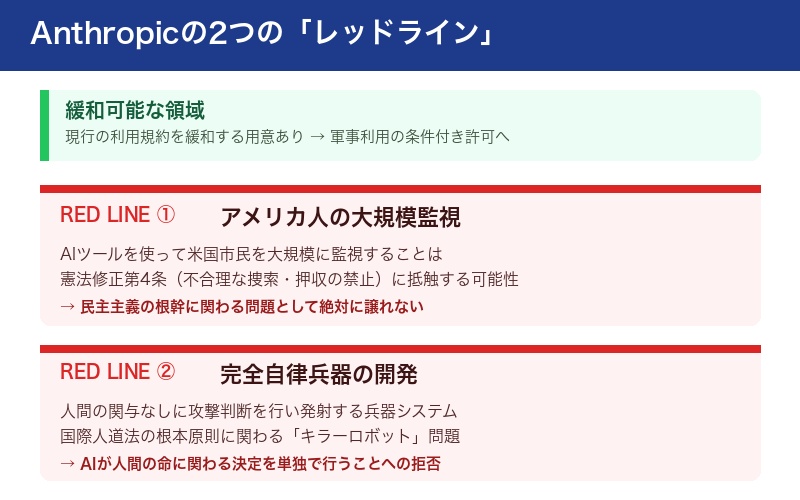

Anthropic CEO ダリオ・アモデイ氏はこの問題を「極めて真剣に」捉えつつも、プラグマティスト(実用主義者)として知られている。同社は現行の利用規約を緩和する用意があるが、2つの「ハードリミット」だけは絶対に譲れないと主張している。

レッドライン①:アメリカ人の大規模監視

AIツールを使って米国市民を大規模に監視することは、憲法修正第4条(不合理な捜索・押収の禁止)に抵触する可能性がある。Anthropicは、自社のツールがこの目的に使われないことを保証したいと考えている。

レッドライン②:完全自律兵器の開発

人間の関与なしに攻撃判断を行い発射する兵器システムの開発は、国際人道法の根本原則に関わる。Anthropicは、AIが人間の命に関わる決定を単独で行うことに対して明確な線引きを求めている。

国防総省報道官ショーン・パーネル氏は、「我が国は、パートナーがいかなる戦いにおいても我々の戦闘員の勝利を助ける意志を持つことを求めている」と述べ、制限なしの協力を要求している。

他のAI企業はどう対応しているのか

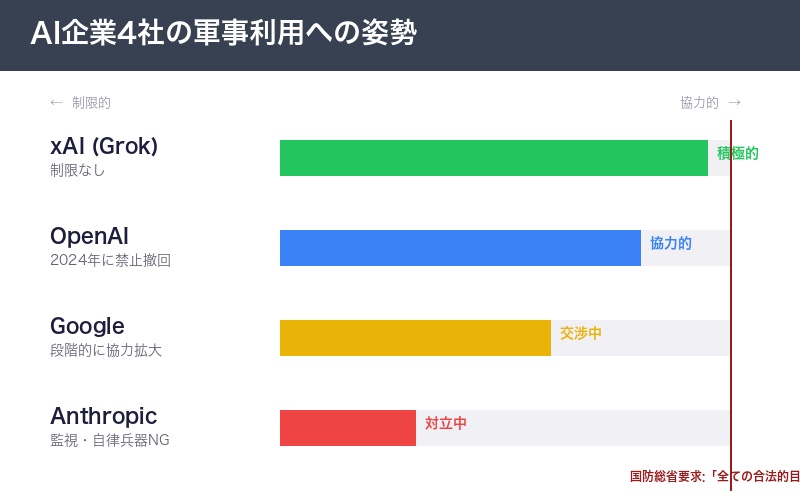

国防総省は、AnthropicだけでなくOpenAI、Google、xAIの4社と並行して交渉を行っている。各社の対応は分かれている。

| 企業 | 軍事利用への姿勢 | 状況 |

|---|---|---|

| Anthropic | 条件付き協力(監視・自律兵器はNG) | 対立激化中 |

| OpenAI | 2024年に軍事利用禁止を撤回済み | 協力的 |

| Project Maven以降、段階的に協力拡大 | 交渉中 | |

| xAI(Grok) | 制限なし | 積極的 |

注目すべきは、OpenAIが2024年に軍事利用禁止の方針を撤回した経緯だ。当初は「軍事・戦争目的での使用禁止」を利用規約に明記していたが、国防総省との関係構築のために方針転換した。Anthropicがこの流れに逆らっていることが、今回の対立の根底にある。

この対立は、トランプ政権がAI企業に対して安全性ガードレールの撤廃を求める圧力を強めている文脈の中で起きている。業界全体に対する前例となる可能性があり、その帰趨はAI倫理の未来を左右する。

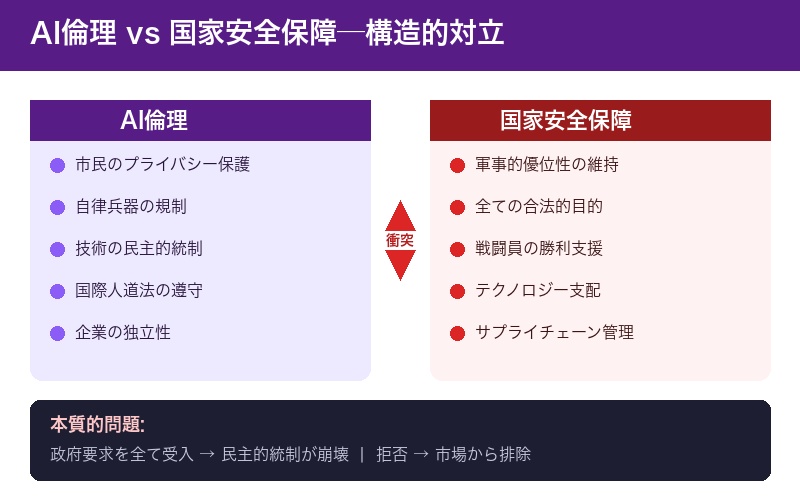

この対立が意味するもの─AI倫理と国家安全保障の衝突

今回の対立は、単なる1企業と政府の契約問題ではない。AI技術の発展と民主主義的価値の両立という、21世紀最大の課題を体現している。

Anthropicの立場には一定の合理性がある。大規模監視と自律兵器は、民主主義社会における基本的人権に直結する問題だ。一方で国防総省の立場にも論理がある。国家安全保障のために最先端技術を制限なく活用することは、軍事的優位性の維持に不可欠だという主張だ。

しかし、「敵対国」に通常適用される制裁措置を自国のテクノロジー企業に適用するという動きは、前例のないエスカレーションだ。The New Republicは「国防総省がAI企業に送った恐ろしいメッセージ」と報じ、これが業界全体への圧力になることを指摘している。

AI企業が政府の要求を全て受け入れれば、テクノロジーの民主的統制という原則が崩壊する。拒否すれば「サプライチェーンリスク」として市場から排除される。この二項対立の構図こそが、今回の対立の本質的な危険性だ。

まとめ─AI時代の「テクノロジーと権力」の新たな構図

国防総省とAnthropicの対立は、AI産業全体の方向性を決定づける可能性がある。重要なポイントを整理すると:

- 前例のない制裁:外国敵対国向けの「サプライチェーンリスク」指定を自国企業に適用する異例の措置

- 2つのレッドライン:Anthropicは大規模監視と完全自律兵器の2点だけは譲れないと主張

- マドゥロ作戦が引き金:Claudeが軍事作戦で使われたことへのAnthropicの懸念表明が対立を決定的に

- 業界への波及:OpenAI、Google、xAIとの交渉にも影響し、AI軍事利用の業界標準が形成される

- 金額vs影響力:契約は2億ドルだが、Claudeは米軍機密システムの唯一のAIモデル

ダリオ・アモデイCEOがプラグマティストとして知られる中でなお堅持する「レッドライン」の存在は、AI企業の安全性コミットメントの真価が問われる瞬間だ。この対立の結末は、AIが人間社会にどのように統合されるべきかという根本的な問いに対する、最初の具体的な回答となるだろう。

コメント